Software, die nicht in Produktion läuft, löst kein einziges Problem. Was trivial klingt, wird in der Praxis überraschend oft ignoriert – mit teuren Konsequenzen. Viele Entwicklungsprojekte verbringen Wochen oder Monate in Planungsschleifen, Konzeptphasen und lokalen Entwicklungsumgebungen, bevor die erste Zeile Code jemals einen echten Nutzer erreicht. Das Ergebnis: Annahmen, die sich zu Illusionen verdichten, technische Schulden, die im Verborgenen wachsen, und Produkte, die am Markt vorbeigehen.

Ein produktionsorientierter Entwicklungsansatz dreht diese Dynamik um. Wer von Tag eins an deployt – in kleinen, kontrollierten Schritten – schafft die Grundlage für technische Belastbarkeit, schnelles Lernen und nachhaltiges Vertrauen zwischen allen Beteiligten. Bei mindtwo setzen wir auf genau diese Philosophie, wenn wir leistungsfähige Webanwendungen und individuelle Software entwickeln: Liefern, validieren, verbessern – jeden Tag.

Die gefährliche Komfortzone der Planung

Es gibt einen Ort, an dem jedes Feature funktioniert, jede Integration nahtlos greift und jeder Nutzer genau das tut, was man erwartet. Dieser Ort ist nicht die Produktionsumgebung – es ist der Kopf des Entwicklungsteams. Man könnte ihn als mentales Modell der Anwendung bezeichnen: ein idealisiertes Bild, in dem Komplexität noch nicht existiert, weil sie noch nicht auf die Realität getroffen ist.

Planungsphasen, Brainstormings und Anforderungsdokumente sind zweifellos wichtig. Doch sie werden gefährlich, wenn sie zum Selbstzweck werden. Denn jedes Feature, das nur auf dem Whiteboard existiert, jede Architekturentscheidung, die nur im Konzeptpapier steht, lebt in einer Welt ohne:

- Legacy-Daten, die nicht in die gewünschte Form passen,

- externe APIs mit Rate Limits und Breaking Changes,

- Performance-Engpässe unter realer Last,

- Sicherheitsanforderungen und Datenschutzregularien,

- echte Nutzer mit unvorhersehbarem Verhalten.

Solange Code nicht in Produktion läuft, bleiben diese Herausforderungen unsichtbar. Annahmen über die technische Machbarkeit und den Produkterfolg bleiben ungetestet. Und je länger dieser Zustand andauert, desto größer wird die Kluft zwischen Erwartung und Wirklichkeit.

Warum die echten Probleme in der Produktion leben

Die Vorstellung, dass Softwareentwicklung primär aus dem Schreiben von Code besteht, greift zu kurz. Code zu generieren wird – nicht zuletzt durch KI-gestützte Werkzeuge – zunehmend einfacher und kostengünstiger. Was hingegen anspruchsvoll bleibt, ist das Betreiben von Software, die unter realen Bedingungen zuverlässig funktioniert.

Eine produktive Anwendung gleicht eher einer Fabrik als einem Werkstück: Daten fließen in spezifischen Formaten und Taktraten, Subsysteme müssen koordiniert werden, neue Module werden integriert – idealerweise ohne Ausfallzeiten. Gleichzeitig gibt es externe Störfaktoren: DDoS-Attacken, ablaufende Zertifikate, inkompatible API-Updates, unerwartete Lastspitzen.

Diese Probleme tauchen weder in der lokalen Entwicklungsumgebung noch in einem Konzeptdokument auf. Sie zeigen sich ausschließlich in der Produktion. Und genau deshalb ist ein früher Weg dorthin so entscheidend: Wer seine schwierigsten Probleme zuerst löst, reduziert das Projektrisiko radikal.

Das 80-Prozent-Problem

Ein Muster, das wir bei mindtwo in der strategischen Beratung immer wieder beobachten: Unternehmen kommen mit der Aussage, sie seien „zu 80 Prozent fertig" und bräuchten nur noch Unterstützung für den letzten Feinschliff. Beim genaueren Hinsehen zeigt sich häufig, dass Models, Controller und Grundstrukturen angelegt wurden – das Skelett einer Anwendung. Doch die wirklich harten Aufgaben stehen noch aus: Datenmigration, Integrationstests, Queue-Management, Caching-Strategien, Berechtigungslogik.

Die Wahrheit ist: Wenn die schwierigsten technischen Probleme noch nicht gelöst sind, ist man weit von 80 Prozent entfernt. Oft definiert erst die Lösung dieser harten Probleme, welche Form die Anwendung tatsächlich annehmen muss.

Technische Viabilität beweisen – nicht vermuten

Der einzige verlässliche Beweis dafür, dass eine technische Lösung funktioniert, ist ihre Funktion in der Produktion. Lokale Tests, Staging-Umgebungen und Code Reviews sind unverzichtbare Qualitätssicherungsmaßnahmen – aber sie können die Bedingungen der realen Produktion nur annähern, nie vollständig abbilden.

Zu den typischen Produktionsproblemen, die sich erst unter Echtbedingungen zeigen, gehören:

- Langläufige Prozesse: Jobs, die mehrere Stunden benötigen und deren Zustandsmanagement komplex ist.

- Dateninkonsistenzen: Historische Daten, die nicht den Annahmen des neuen Features entsprechen.

- Externe Abhängigkeiten: Storage-Provider, Mail-Dienste, DNS-Konfigurationen und Caching-Schichten, die jeweils eigene Fehlerquellen mitbringen.

- Skalierungsverhalten: Performance-Charakteristiken unter realer Last, die sich in künstlichen Testumgebungen kaum simulieren lassen.

Der jährlich von Google veröffentlichte DORA-Report (Accelerate State of DevOps) bestätigt diesen Zusammenhang empirisch: Teams, die häufiger deployen – idealerweise mehrmals täglich – erreichen signifikant bessere Werte bei Lead Time, Change Failure Rate und Mean Time to Recovery. Die Deployment-Frequenz ist dabei nicht nur ein Indikator für Geschwindigkeit, sondern für die Gesamtreife eines Entwicklungsprozesses.

Produktviabilität: Schnelles Lernen statt langer Annahmen

Neben der technischen Viabilität steht die ebenso kritische Frage der Produktviabilität: Löst die Software tatsächlich ein Problem, für das Menschen bereit sind zu zahlen? Werden Nutzer die Anwendung verstehen und regelmäßig nutzen?

Solange ein Produkt nur als Konzept existiert, sind sämtliche Antworten auf diese Fragen Hypothesen. Und Hypothesen haben eine unangenehme Eigenschaft: Sie können falsch sein. Die entscheidende Frage ist nicht ob eine Annahme von der Realität abweicht, sondern wann man es herausfindet.

Das Prinzip des schnellen Scheiterns

Wer eine Woche entwickelt und dann eine Funktion ausliefert, erfährt schnell, ob die Hypothese stimmt. Kleine Korrekturen halten das Produkt auf Kurs. Wer hingegen sechs Monate ohne Nutzerfeedback baut, riskiert, dass eine anfangs kleine Abweichung sich zu einer fundamentalen Fehlausrichtung ausgewachsen hat.

Schnelles Scheitern ist kein Versagen – es ist eine der wertvollsten Informationsquellen überhaupt. Es liefert hochqualitative Daten darüber, was funktioniert und was nicht. Und diese Daten entstehen nur in der Produktion, nicht in der Planungsphase.

Die wissenschaftliche Basis hierfür ist solide: Forschungen zu Continuous Delivery zeigen, dass häufige, kleine Releases nicht nur die Fehlerrate senken, sondern auch die Produktqualität steigern, weil Feedback-Schleifen drastisch verkürzt werden.

Vertrauen und Kosten: Die unterschätzte Dimension

Ein Aspekt, der in technischen Diskussionen oft untergeht, ist der Zusammenhang zwischen Liefergeschwindigkeit und Vertrauen. Ob internes Team oder externer Dienstleister: Wer über Wochen keine sichtbaren Ergebnisse liefert, erodiert das Vertrauen seiner Auftraggeber – unabhängig davon, wie intensiv im Hintergrund gearbeitet wird.

Konzeptphasen und Planungszyklen kosten Geld. Sie sind dann gerechtfertigt, wenn sie direkt in umsetzbare Ergebnisse münden. Doch wenn Planung zur Dauerbeschäftigung wird, verschiebt sich das Kosten-Nutzen-Verhältnis dramatisch. Jeder Tag ohne lieferbare Ergebnisse ist ein Tag, an dem Budgets verbrannt werden, ohne messbaren Fortschritt zu erzeugen.

Für Unternehmen, die mit externen Partnern zusammenarbeiten, bedeutet das: Der richtige Entwicklungspartner liefert ab Tag eins – nicht erst nach einer mehrwöchigen Analysephase.

Strategien für kontinuierliches Deployment

Die Theorie ist überzeugend – doch wie setzt man einen Production-First-Ansatz in der Praxis um? Besonders bei bestehenden Anwendungen mit Legacy-Code und gewachsenen Datenstrukturen ist das keine triviale Aufgabe. Drei Strategien haben sich als besonders wirksam erwiesen.

1. In vertikalen Schichten bauen

Der natürliche Impuls bei einem neuen Feature ist oft, horizontal vorzugehen: zuerst die gesamte Backend-Logik, dann alle Tests, dann die Controller, schließlich das Frontend. Das Problem: Bis das Feature vollständig steht, gibt es nichts Zeigbares – und wenn sich am Ende herausstellt, dass die User Experience anders hätte gestaltet werden müssen, bricht alles zusammen.

Die Alternative ist das Vertical-Slice-Prinzip: Statt schichtweise aufzubauen, identifiziert man die dünnste mögliche Full-Stack-Funktion, die sich heute liefern lässt. Ein vertikaler Schnitt umfasst Backend, Frontend und Tests – und ist so schmal, dass er in einem einzigen, überschaubaren Pull Request deployt werden kann.

Die Vorteile dieses Ansatzes sind erheblich:

| Aspekt | Horizontaler Aufbau | Vertikale Schnitte |

|---|---|---|

| Zeit bis zum ersten Ergebnis | Wochen bis Monate | Stunden bis Tage |

| Risiko bei Richtungsänderung | Hoch – alles muss umgebaut werden | Gering – nächster Schnitt passt sich an |

| PR-Größe | Tausende Zeilen, schwer zu reviewen | Überschaubar, schnell zu prüfen |

| Feedback-Zyklen | Sehr lang | Kontinuierlich |

| Team-Momentum | Langsam aufbauend | Sofort spürbar |

Vertikale Schnitte erzwingen zudem eine produktive Konversation darüber, was als Nächstes den größten Mehrwert liefert. Statt einen monolithischen Feature-Block abzuarbeiten, entsteht ein priorisierter Strom kleiner, wertvoller Inkremente.

2. Das Strangler-Fig-Pattern für Legacy-Systeme

Für Unternehmen, die bestehende Anwendungen modernisieren müssen, bietet das erstmals von Martin Fowler beschriebene Strangler-Fig-Pattern einen strukturierten Migrationspfad. Die Metapher stammt von der Würgefeige, einem Baum, der auf einem anderen Baum wächst: Er lässt zunächst eine einzelne Ranke hinab, bis diese den Boden erreicht und Nährstoffe aufnehmen kann. Dann folgen weitere Ranken, bis der neue Baum den alten vollständig umhüllt hat.

Übertragen auf die Softwareentwicklung bedeutet das: Legacy-Systeme werden nicht in einem großen Wurf ersetzt, sondern schrittweise – Funktionalität für Funktionalität. Jede neue Komponente wird als eigenständiger, vertikaler Schnitt neben der bestehenden Logik aufgebaut. Sobald sie produktionsreif ist, übernimmt sie die Rolle ihres Legacy-Pendants.

Dieser Ansatz reduziert das Migrationsrisiko massiv. Statt eines angsteinflößenden Big-Bang-Releases entsteht ein kontrollierter, gradueller Übergang. Und weil jeder Schritt einzeln deployt und validiert wird, behält das Team jederzeit die Kontrolle über den Prozess.

Gerade bei der Ablösung oder Modernisierung bestehender Webplattformen ist dieses Vorgehen ein bewährter Standard: Risiken minimieren, Betriebskontinuität sichern, schrittweise Mehrwert schaffen.

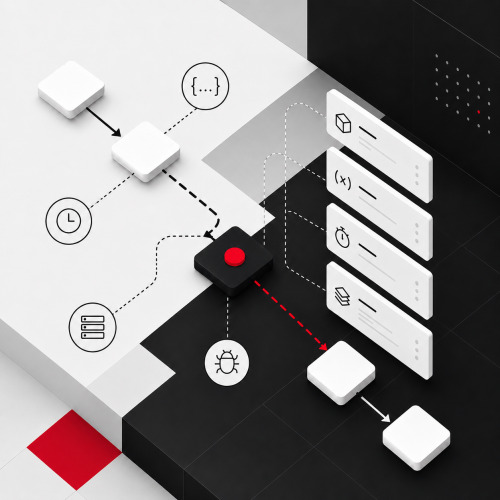

3. Feature Flags als Deployment-Enabler

Feature Flags – auch Feature Toggles genannt – sind der technische Schlüssel, der kontinuierliches Deployment auch bei großen, riskanten Änderungen ermöglicht. Das Prinzip: Neuer Code wird in die Produktion deployt, aber hinter einem Schalter verborgen. Erst wenn die Funktion bereit ist, wird sie für ausgewählte oder alle Nutzer freigeschaltet.

Die Einsatzszenarien sind vielfältig:

- Graduelle Rollouts: Neue Features zunächst nur für eine kleine Nutzergruppe aktivieren und bei Problemen sofort zurückrollen.

- Interne Vorab-Nutzung: Das Team verwendet die neue Funktion intern, bevor sie öffentlich wird – und findet Bugs und UX-Probleme unter realen Bedingungen.

- Parallele Entwicklung: Mehrere Teams arbeiten gleichzeitig an unterschiedlichen Features, ohne sich gegenseitig zu blockieren.

- Entkopplung von Deployment und Release: Code kann jederzeit deployt werden; der Release-Zeitpunkt wird unabhängig davon gesteuert.

Selbst umfangreiche Umbauten – etwa die Einführung eines neuen Datenmodells, das sämtliche bestehenden Entitäten betrifft – lassen sich hinter einem einzigen Feature Flag durchführen. Der Vorteil: Die Änderung lebt bereits in Produktion, wird dort getestet und gehärtet, Monate bevor sie für Endnutzer sichtbar wird.

Die lokale Umgebung der Realität annähern

Ein weiterer, oft unterschätzter Hebel liegt in der Gestaltung der lokalen Entwicklungsumgebung. Typische Seeder erzeugen kleine, wohlgeformte Datensätze, die exakt den Happy Path abbilden. Produktionsdaten hingegen sind groß, unregelmäßig und voller historischer Inkonsistenzen.

Wer lokal ausschließlich mit idealisierten Testdaten arbeitet, erlebt beim Deployment regelmäßig böse Überraschungen. Die bessere Alternative – wo datenschutzrechtlich und technisch möglich – sind anonymisierte Produktionsdaten in der Entwicklungsumgebung. Sie zwingen dazu, sich bereits während der Entwicklung mit der realen Datenlage auseinanderzusetzen.

Dasselbe Prinzip gilt für externe Dienste: API-Sandboxes sind Mocks überlegen, weil sie das tatsächliche Verhalten der Schnittstelle besser abbilden. Je näher die lokale Umgebung an die Produktionsrealität heranreicht, desto reibungsloser verlaufen spätere Deployments.

Ein strukturierter Weg zur kontinuierlichen Auslieferung

Für Unternehmen, die ihren Entwicklungsprozess in Richtung kontinuierlicher Auslieferung transformieren möchten, empfiehlt sich ein schrittweises Vorgehen:

- Deployment-Pipeline etablieren: Automatisierte Tests, Build-Prozesse und Deployments als technische Grundlage schaffen.

- Feature Flags einführen: Die Entkopplung von Deployment und Release als organisatorisches Werkzeug etablieren.

- Pull-Request-Kultur schärfen: Kleine, reviewbare PRs statt monolithischer Feature-Branches. Schnelle Review-Zyklen sind essenziell.

- Vertikale Schnitte als Standard: Teams trainieren, Features in die dünnsten möglichen Full-Stack-Inkremente zu zerlegen.

- Produktionsdaten nutzen: Lokale Umgebungen mit realistischen Daten ausstatten, um Überraschungen zu minimieren.

- Feedback-Schleifen verkürzen: Interne Nutzung neuer Features unter Echtbedingungen, bevor der öffentliche Rollout erfolgt.

Dieser Prozess erfordert nicht nur technische Anpassungen, sondern auch ein organisatorisches Umdenken. Review-Prozesse müssen beschleunigt, Ticket-Systeme effizient genutzt und Priorisierungsentscheidungen kontinuierlich getroffen werden. Doch der Aufwand lohnt sich: Das Ergebnis sind Teams, die täglich Mehrwert liefern – statt monatelang auf einen großen Release hinzuarbeiten.

Warum sich die Investition lohnt

Die Vorteile eines produktionsorientierten Entwicklungsansatzes wirken auf mehreren Ebenen gleichzeitig:

- Risikoreduktion: Kleine, häufige Änderungen sind leichter zu kontrollieren und zurückzurollen als große Releases.

- Schnellere Time-to-Market: Neue Funktionen erreichen Nutzer in Tagen statt Monaten.

- Höhere Produktqualität: Kurze Feedback-Schleifen ermöglichen kontinuierliche Verbesserung auf Basis realer Nutzungsdaten.

- Stärkeres Vertrauen: Regelmäßige, sichtbare Fortschritte schaffen Vertrauen bei Stakeholdern und Auftraggebern.

- Effizienterer Ressourceneinsatz: Weniger verschwendete Entwicklungszeit durch frühzeitige Validierung von Annahmen.

- Zukunftssichere Architektur: Vertikale Schnitte und das Strangler-Pattern führen zu modularen, wartbaren Systemen.

Fazit: Die Fabrik schlägt den Elfenbeinturm

Software zu entwickeln bedeutet nicht, perfekte Pläne zu schmieden. Es bedeutet, funktionierende Lösungen in die Hände realer Nutzer zu bringen – und zwar so früh und so häufig wie möglich. Jeder Tag, an dem Code nur lokal existiert, ist ein Tag ohne valide Erkenntnisse über technische Machbarkeit und Produkterfolg.

Die Strategien dafür sind erprobt: vertikale Schnitte für schnelle Lieferung, das Strangler-Fig-Pattern für sichere Migration, Feature Flags für kontrollierte Rollouts und realitätsnahe Entwicklungsumgebungen für weniger Überraschungen. Gemeinsam bilden sie ein Framework, das sowohl für neue Projekte als auch für die Modernisierung bestehender Systeme funktioniert.

Wer seine digitale Plattform, Webanwendung oder Individualsoftware mit diesem Anspruch entwickeln möchte – präzise, inkrementell und produktionsorientiert – findet in mindtwo einen Partner, der genau so arbeitet: Ab Tag eins in der Produktion, jeden Tag ein Stück besser.